- 0

- 0

- 0

分享

- 2020级博士研究生黄强论文被CCF A类期刊TKDE接收

-

原创 2022-06-24

人工智能学院常毅教授指导的2020级博士研究生黄强的论文GraphLIME: Local Interpretable Model Explanations for Graph Neural Networks近日被CCF-A类期刊IEEE TRANSACTIONS ON KNOWLEDGE AND DATA ENGINEERING(简称TKDE)接收。黄强同学为第一作者。

TKDE是人工智能、机器学习以及数据挖掘领域顶级的学术期刊之一,CCF-A。

黄强从事特征选择、因果数据挖掘相关的研究工作,本篇文章与吉林大学的田原老师,日本京都大学的Makoto Yamada老师合作完成。

文章详情

论文题目:

Local Interpretable Model Explanations for Graph Neural Networks

第一作者:黄强

收录期刊:TKDE

合作导师:常毅、田原、Makoto Yamada

论文概述:

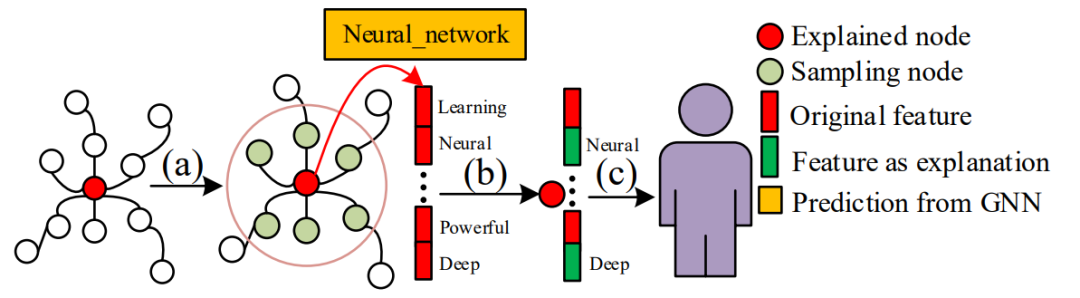

图结构数据在物理、化学、生物、计算机视觉和社交网络等各个领域都有广泛的适用性。近些年,图神经网络(GNN)由于其良好的性能和泛化能力,被证明是一种可以有效表示和建模图结构数据的机器学习方法。然而,解释GNN模型的有效性是一项具有挑战性的任务,因为其在迭代过程中进行了复杂的非线性转换。本篇研究工作提出了一种非线性的GNN解释框架GraphLIME,这是一个使用Hilbert-Schmidt Independence Criterion (HSIC) Lasso的图结构局部可解释模型方法,HSIC Lasso是一种非线性特征选择方法,相比于线性方法能够更好地逼近GNN的决策过程。GraphLIME是一个通用的GNN模型解释框架,它在被解释节点的子图中局部学习一个非线性可解释模型,并基于该可解释模型产生对应的GNN解释信息。

吉林大学|人工智能学院

吉林省长春市|吉林大学中心校区

正新楼|7F

-

阅读原文

* 文章为作者独立观点,不代表数艺网立场转载须知

- 本内容由数艺网主动采集收录,信息来源为 “吉林大学人工智能学院” 公开网络发布内容。第三方如需转载本内容,必须完整标注原作者信息及 “来源:数艺网”,严禁擅自篡改、删减或未标注来源转载。 并附上本页链接: 若您的内容不希望被数艺网收录,或认为此举侵犯了您的合法权益,敬请通过微信 ID:d-arts-cn 联系数艺网。我们将致以诚挚歉意,并第一时间为您办理下架或删除处理。