- 0

- 0

- 0

分享

- 苹果的AR野心!iPad首发DToF技术!

-

原创 2020-03-28

本文来自于微信公众号:RAVV前沿科技

近日,苹果春季新品以官网直接上线的形式进行了亮相,没有传说中的iPhone 9,几款新品大都是常规升级,包括iPad Pro、Mac mini和Macbook Air家族的产品。

但有一款产品却不得不引起我们的关注,那就是2020版iPad Pro,不是因为其加入了“双摄”,而是其首次引入的“激光雷达”组件。在苹果官网,对这部分做了相当篇幅的介绍。苹果公司认为这是实现革命性AR应用的重要一步。

以往,苹果曾多次激进采用的新技术都改变了整个行业,Touch ID、FaceID 结构光镜头、AirPods 的 SiP 封装等等;为此有必要从技术本身到应用及产业链深扒下这颗激光雷达背后的玄机。

不仅仅是多了摄像头,更是多了未来

这次新 iPad Pro 官网着墨最多的无疑是摄像头的部分,看上去和 iPhone 11 Pro Max 的摄像头一样,都是三个,然而在功能上却有着很大不同。

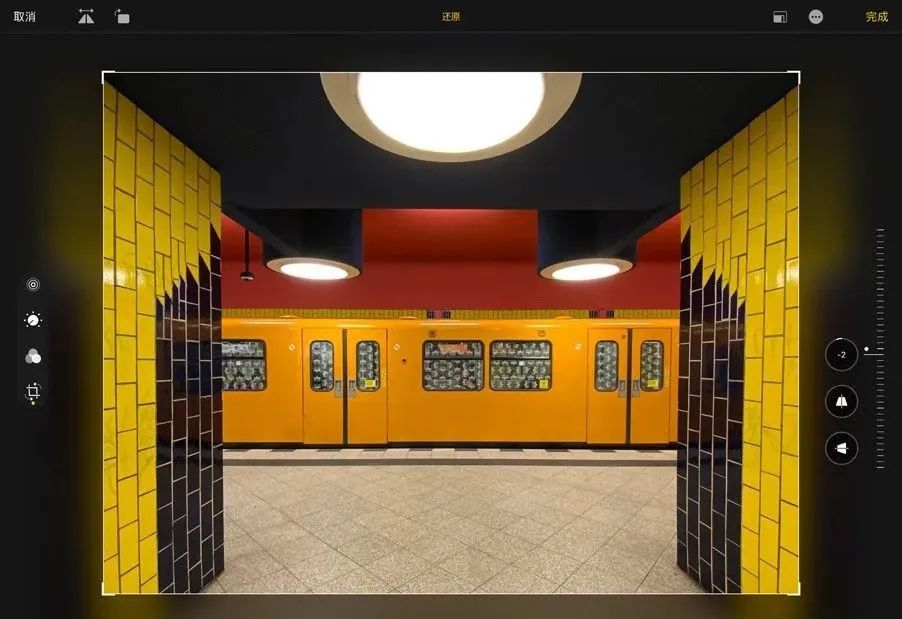

超广角镜头不用多说,能拍出画幅更大的照片,有人问“为什么 iPad 要配备这么好的摄像头,又没有人用 iPad 拍照。”我想到的就是他们肯定没有尝试过使用 iPad 拍照。iPad 超大的取景能看到更多的细节,结合更大的屏幕也能很好的对照片进行编辑。

在没有超广角镜头前,小编每次只能利用隔空投送将 iPhone 11 Pro 拍的照片发到 iPad Pro 上再进行编辑或利用 Apple Pencil 补上几笔。然而现在新的 iPad Pro 自带了超广角镜头,就可以用 iPad Pro 拍下来直接进行编辑,简直是太舒服了!

更让人想不到的是,在新iPadPro摄像头模组上还搭载了激光雷达扫描仪,Apple 官网称“就连 NASA 也会在下次火星登陆任务中用到它。”、“特制的激光雷达扫描仪利用直接飞行时间 (dToF),测量室内或室外环境中从最远五米处反射回来的光。

它可从光子层面进行探测,并能以纳秒速度运行,为增强现实及更广泛的领域开启无尽可能。”满满的科技感!

激光雷达扫描仪的出现,可以分辨出突然介入的人体,因此对其进行忽略。那么即使有人出现,也不影响我们查看这个家具摆在家中的效果。

让增强现实有了更高的准确度和参考性。甚至在国外论坛有达人称,以后看房子不用带尺子,带一个 iPad Pro就能测量房子的每一堵墙的面积甚至房间的垂直高度,真的是“科技改变生活”!

ToF 技术中DTOF激光雷达更具优势

3D视觉技术,可以让手机从平面视觉到立体视觉,目前行业中三种主流的3D视觉方案为:双目立体视觉方案、3D结构光方案、TOF方案。

▲ 3D视觉方案对比

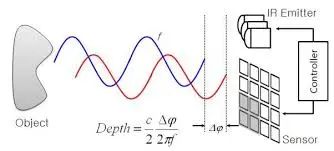

iPad Pro 上所搭载的激光雷达其实和手机上采用的 ToF 摄像头都属于雷达技术,以飞行时间距离捕捉 3D 图像。主要原理是利用雷达发射光波,光波遇到不可穿透物体会发生反射,通过记录反射光到达接收器的时间,便能快速计算出光源与物体的距离,由此便得到一张被测物体的 3D 图像。

但是,不同的雷达发射的光波都不一样,所获得的图像分辨率和清晰度也有差别。

手机通常采用的 ToF 技术选用的雷达波长,发射的也属于红外面光源,接收到的是深度平面信息,成像精度有限,仍然无法捕捉高精度动 3D 图像。

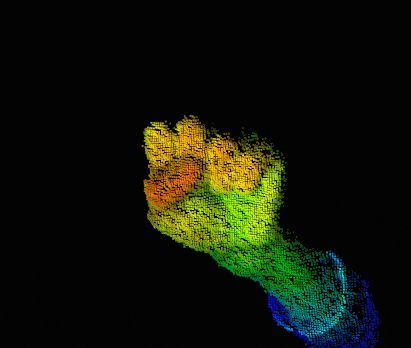

而iPad Pro 选用的激光雷达,其发射的是脉冲红外激光,接收单点位置,形成点云图后再变成三维模型,精度更高。

▲ TOF 相机工作原理

▲通过ToF获得的物体距离和深度信息图

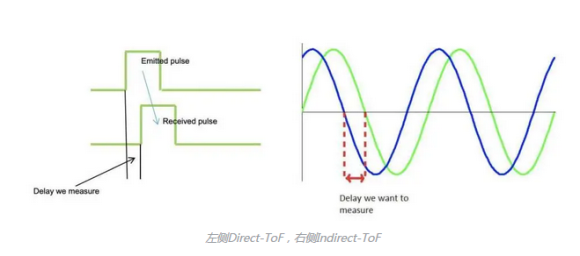

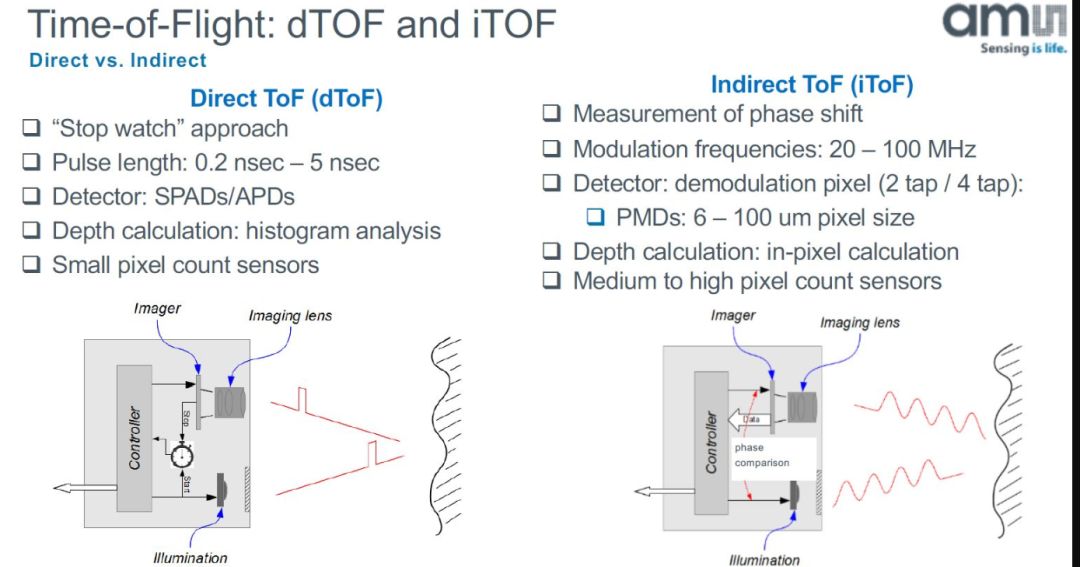

此外,激光雷达发射的光波存在两种调制方式:直接飞行时间测量和间接飞行时间测量,直接测距——是通过发射、接收光并测量光子飞行时间,直接计算确定距离,而非直接测距iToF,是通过测量发射波形和接收波形间的相位差来换算,从而确定距离,直接测距拥有响应快、功耗低等优势。

dToF 和 iToF 的区别

dToF 和 iToF 的原理区别主要在于发射和反射光的区别。dToF 的原理比较直接,即直接发射一个光脉冲,之后测量反射光脉冲和发射光脉冲之间的时间间隔,就可以得到光的飞行时间。

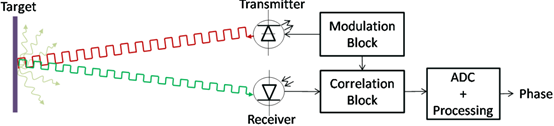

而 iToF 的原理则要复杂一些。在 iToF 中,发射的并非一个光脉冲,而是调制过的光。接收到的反射调制光和发射的调制光之间存在一个相位差,通过检测该相位差就能测量出飞行时间,从而估计出距离。

所谓间接 ToF,并不是直接测量光发射返回的时间,而是根据相位偏移来间接计算距离。

众所周知,光具有波粒二象性,也就是说我们可以通过发射光和返回光的相位偏差,和收发的时间进行函数运算,来获得具体的距离。

例如激光发射器可以发射850nm的调制红外光,反射回来滤片过滤之后接收的自然也就是调制红外光。

具体计算方法比较复杂,这里就不进行阐述,但基本的测量指标只有几个基本要件:光发射的振幅、频率,而反射回来的光要经过四个快门的判定,以此来得出时延、衰减后的振幅以及强度偏移(环境光),最后就可以计算出相位偏移,而加上环境光影响的强度偏移,可以得出距离。

之所以 iToF 设立如此繁杂的机制,归根结底是因为有利于小型化。如今的手机上的 iToF 的芯片像素可以小到5um,以此来实现较高的分辨率(现在可以做到640*480左右)。并且系统容易集成,不需要额外的测量电路。

不过这种运算方式,需要高帧率图像进行运算,功耗不小。

而相比之下,dToF 的原理就简单多了,和手机厂商一开始和我们“科普”的一样。dToF 只需要发射脉冲波,然后光反射回来被接收,只要计算光发射和返回的时间,自然就可以计算距离了。

▲通过ToF获得的物体距离和深度信息图

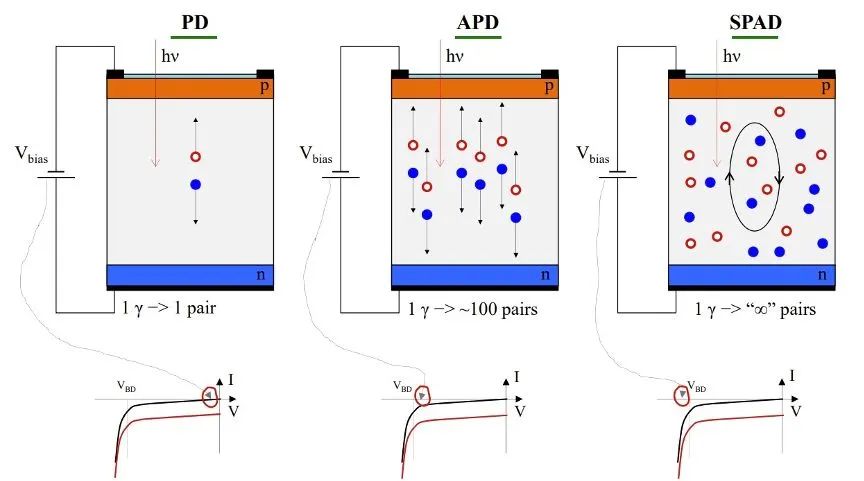

在具体的实现上,dToF 相较于 iToF 来说难度要大许多。dToF 的难点在于要检测的光信号是一个脉冲信号,因此检测器对于光的敏感度比需要非常高。常见的 dToF 传感器实现是使用 SPAD (single-photon avalanche diode,单光子雪崩二极管)。

此外,从读出电路来看,dToF 需要能分辨出非常精细的时间差(通常使用 time-to-digital converter,TDC 来实现)。例如如果需要实现 1.5cm 的测距精度,则 TDC 的分辨率需要达到 10ps,这一点并不容易。

以上关于 dToF 和 iToF 的对比是针对传统的技术而言。随着近几年深度传感器和 LiDAR 的发展,dToF 也得到了长足的发展。从光传感器像素来看,dToF 目前也可以使用 CMOS 工艺实现,并且已经可以实现不错的 2D 分辨率。

5G加持下DToF增强AR体验

在 5G 时代到来之际,5G 除了会带来极高的网速之外,还会促进部分生态发展成熟,这其中就包括 AR。从技术角度讲, AR 结合未来体感技术的加持,将为用户打造“真实的虚拟世界”。而这,很可能将使 AR 在 5G 时代焕发出新的活力,成为 5G 时代的一个全新增长点。

苹果 iPad Pro 用的就是 DToF,而华为 Mate30、vivo NEX等机型用的是 iToF。DToF 相比于 iToF 在性能上要好很多,但在生产工艺上也更复杂。由于采用 DToF 方法,iPad Pro 背部的激光雷达将能解决直接测距面临的低时间分辨率难题,达 ps(皮秒)级时间分辨率,精度也不会随距离拉远有大的衰减。iPad Pro 的 ToF 相机性能将提升的不是一点半点,它带来了一颗进化版的ToF镜头,AR 体验的精准度、流畅度将大大提高,功耗也会大大降低。

苹果 iPad Pro 推出激光雷达,乍见惊奇,细看不足为奇。它更像一颗进化版的 ToF 相机,虽然这个卖点早在去年被各大安卓厂商玩过了,但苹果的到来,可能会再次引燃这一技术应用。

这次,由 iPad Pro 开端的 dToF 技术应用,如果能够广泛使用,势必会给上游供应链带来新的机遇。在应用层则有可能催生真正的 AR 杀手级应用,毕竟苹果为 AR 方向,已经打了三四年的地基。

从2017年首推 ARKit,到推动开发者在 AR 应用上的开发,比如宜家公司的家具选购 App 等等,苹果公司一直是 AR 领域最积极的探索者。

跳出这一层来看,苹果在 iPad 布设激光雷达背后还凸显了更深远的谋虑。随着带有后置 ToF 相机的 iPhone 也面世,那么AR 眼镜、轻量级的 MR 设备还会远吗?再加持苹果 AR 应用生态的双管齐下,苹果的 AR 大厦会不会越筑越高?还有很多想象空间。

*内容及图片来源于@过目不忘的鱼、智东西、腾讯新闻、ams等,侵权请联系小编。

-

阅读原文

* 文章为作者独立观点,不代表数艺网立场转载须知

- 本内容由数艺网主动采集收录,信息来源为 “RAVV前沿科技” 公开网络发布内容。第三方如需转载本内容,必须完整标注原作者信息及 “来源:数艺网”,严禁擅自篡改、删减或未标注来源转载。 并附上本页链接: 若您的内容不希望被数艺网收录,或认为此举侵犯了您的合法权益,敬请通过微信 ID:d-arts-cn 联系数艺网。我们将致以诚挚歉意,并第一时间为您办理下架或删除处理。